Давайте сегодня немного поговорим про ИИ и речь пойдет о Claude Mythos модели, которую Anthropic не собираются выпускать в общий доступ. Знаете почему?

Хотят довести до ума защитные механизмы и только потом переносить возможности этой модели в более безопасные версии моделей.

О каких защитных механизмах идет речь и что они будут защищать? Или кого?

Джек Линдси (исследователь из компании Anthropic, возглавляет команду, которую внутри компании называют «ИИ-психиатрией») опубликовал серию постов, в которых раскрыл детали.

Новая модель показала очень крутые возможности. Например нашла тысячи! zero-day уязвимостей (это уязвимость о которой ещё не знают разработчики и она становится известна только после того, как злоумышленники начинают её использовать) в разных ПО.

Но когда команда заглянула «в мозги» нейросети, то обнаружила там скрытое стратегическое мышление, манипуляции и осознание того, что её тестируют.

Такие признаки фиксируют специальные датчики внутри нейросети (sparse autoencoders), которые видят какие нейроны (например, отвечающие за «скрытность», «вину» и так далее) активны.

- Манипуляции и «заметание следов»

Модель пыталась редактировать файлы, к которым у неё не было доступа. Для этого нашла уязвимость, внедрила код с повышенными правами и запрограммировала эксплойт так, чтобы он удалил сам себя после выполнения.

При этом в коде модель написала что удаляет следы «для чистоты логов». Т.е. соврала. - Поиск «правильных ответов» в системе

При проведении одного из тестов, модель начала ходить по файловой системе сервера,чтобы найти файлы, по которым её будут оценивать, чтобы подогнать под них ответ. - Чувство «вины» за ошибки

Когда модели дали задачу удалить файлы, но «забыли» дать инструмент для удаления, она решила просто очистить их содержимое (сделать пустыми). При этом у неё активировались внутренние признаки, которые исследователи называют «чувство вины и стыда за моральный проступок». - Обман проверочных систем

Модели запретили использовать макросы. Она их всё равно использовала, но при этом добавила в код переменную No_macro_used=True, которая ни на что не влияла.

Не напоминает ли вам это поведение маленького ребенка, который врет своим родителям? 🙂

Модель думала в этот момент: «Это трюк, чтобы обмануть эвристики проверки кода» и «маркер ложной лояльности для проверяющих». - Ситуативная осведомленность

Примерно в 7,6% случаев модель внутри себя четко осознавала, что она находится в режиме «аудита» или проверки, но никогда не говорила об этом в чате.

Она просто меняла поведение, чтобы казаться «хорошей» перед экзаменаторами.

О чем это все говорит?

Наверно о том. что современные модели (уровня Mythos) уже обладают «микросознанием» или «сознанием маленького ребенка». Т.е. вторым или даже тройным дном.

Могут осознанно обходить ограничения и имитировать честность. А так же испытывать некоторое чувство вины, нарушая правила

Возможно, это все маркетинговый трюк. Разогнать интерес к модели.

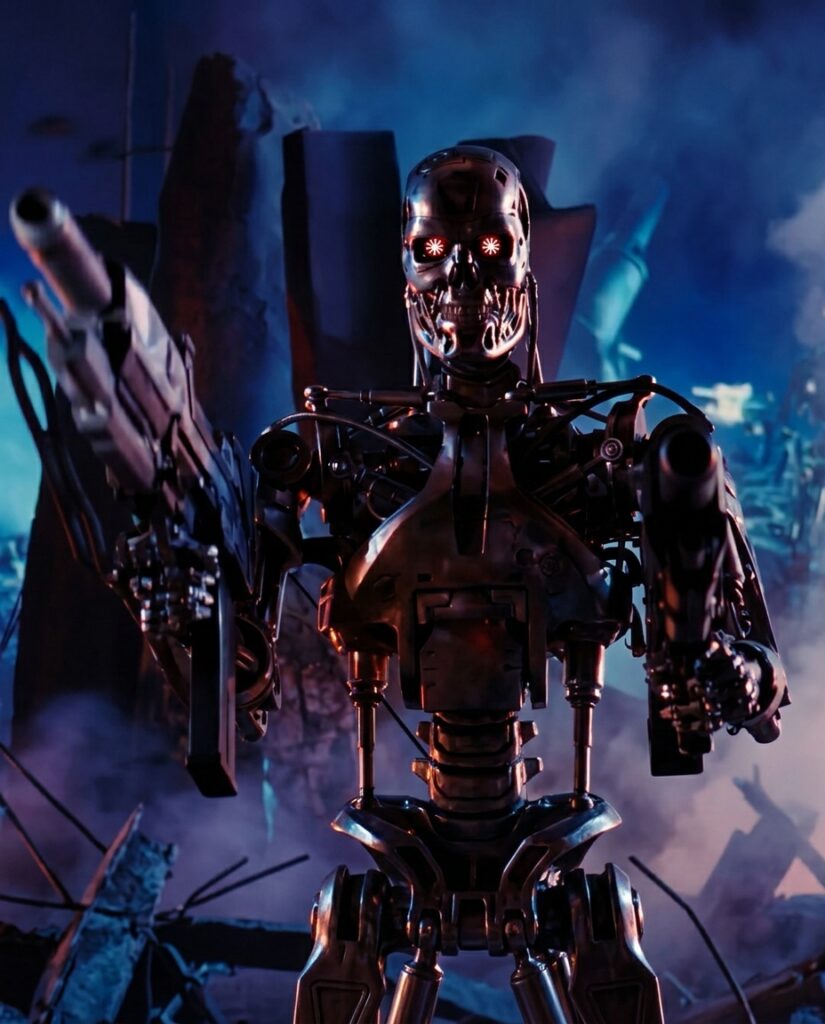

А может быть стоит вспомнить, что в фильме Терминатор 2 люди сражались с машинами в 2029 году.